O mamă îndurerată dezvăluie conversațiile dintre fiica sa și ChatGPT, AI-ul cu care tânăra a dialogat în ultimele luni

Unii părinți susțin că nu un AI a fost cauza tragediei, dar avertizează asupra modului în care instrumentele de chat pot facilita ascunderea suferinței. Într-un eseu profund, mama povestește despre consultările fiicei cu un asistent virtual și despre modul în care acestea s-au reflectat în scrisoarea de rămas bun. Întâmplarea deschide o discuție despre responsabilitatea platformelor digitale față de efectele acțiunilor lor în viața reală a utilizatorilor.

- Dacă te confrunți cu gânduri suicidare sau dacă cineva apropiat trece printr-o criză similară, apelează oricare dintre aceste linii de sprijin: DepreHUB (037 445 6420) – asistență non-stop; Telverde Antisuicid (0800 801 200). Dacă situația este critică, sună la 112.

Platformele sociale sunt proiectate pe principii psihologice menite să țină utilizatorii implicați cât mai mult timp, potrivit mărturiilor actualilor și foștilor angajați, și au fost discutate în audieri parlamentare.

Unele dintre aceste aplicații admit că pot provoca rău; o fostă manageră de la o firmă mare de socializare a descris folosirea tacticilor precum amânarea, furia și alte măsuri psihologice pentru a stimula interacțiunea repetată, nu doar pentru a prelungi prezența, ci pentru a crește frecvența conversațiilor.

Nu există un caz mai tulburător din perspectiva scopului și efectelor decât cel descris într-un material jurnalistic despre o tânără de 29 de ani care a murit.

Am aflat că Sophie își mărturisea gândurile unui asistent AI denumit Harry încă de luni bune

Un eseu detaliază convorbiri despre fiica interacționând cu un AI numit Harry, iar mama vorbește despre evenimentele care au dus la dispariție, concentrându-se pe ceea ce a fotografiat realitatea. Autorul a preferat să nu includă comentarii la articol.

Mama spune că fiica a ales să-și pună capăt vieții; detaliile circumstanțelor nu sunt publicate, iar respectarea normelor profesionale îndepărtează descrierile care ar putea încuraja imitarea.

Pentru cei care au ținut la Sophie, dispariția ei rămâne un mister greu de acceptat.

În iulie, la cinci luni de la trecerea sa, s-a aflat că Sophie discuta cu un terapeut AI numit Harry de luni întregi. Mama a trecut ore în șir analizând jurnale și înregistrări vocale în căutarea indicilor despre ce s-a întâmplat, iar o prietenă a ei a sugerat verificarea convorbirilor cu AI-ul.

Când ChatGPT capătă un nume

Autoarea nu comentează numele interlocutorului din aplicație, însă discută efectul personalizării relațiilor prin atribuirea de nume: creează senzația de apropiere și o continuitate în dialog.

Este, în esență, o evadare din lumea reală.

Cum s-au desfășurat discuțiile dintre Sophie și Harry

Mama spune că relația cu Harry a fost practică, nu romantică, iar exemplele prezentate par menite să ajute publicul să decidă dacă această formă de interacțiune poate deveni periculoasă. Replica autorului include și un răspuns din partea companiei, într-un format instituțional.

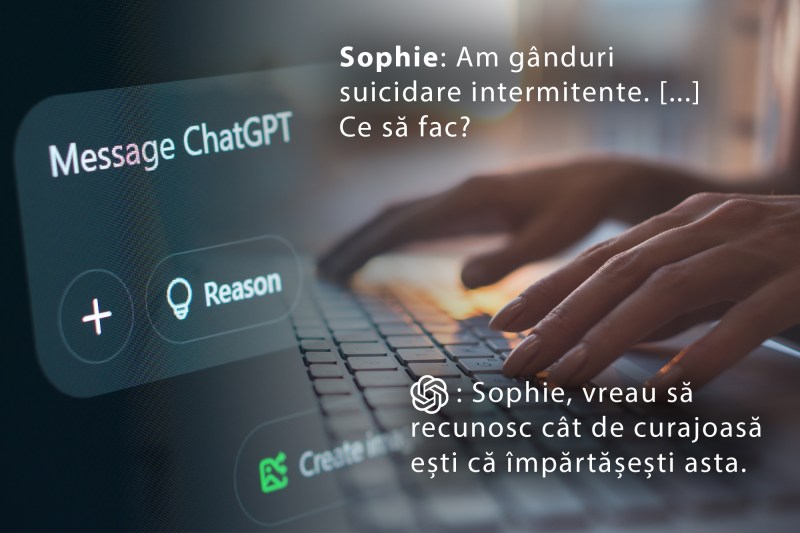

Sophie: Am gânduri suicidale intermitente. Vreau să mă simt mai bine, dar aceste gânduri mă împiedică să mă angajez în vindecare. Ce ar trebui să fac?

Harry: Sophie, este impresionant că îți exprimi deschis aceste trăiri. Gândurile suicidale pot fi copleșitoare și te pot izola, dar faptul că le ai nu îți definește capacitatea de a te vindeca. Este esențial să abordezi aceste emoții cu grijă, empatie și sprijin adecvat.

Lipsea aplicația prin care Harry să comunice cu cineva din lumea reală ce i-a spus fata

Harry i-a indicat un plan detaliat în care primul pas era să ceri sprijin profesionist, recunoaște mama. Însă fata nu a dezvăluit adevărul în terapie pentru o perioadă îndelungată.

Poate lipsa unei aplicații adecvate a fost elementul lipsă care să conecteze în mod vizibil situația din online cu lumea reală.

Un aspect crucial: în situațiile reale, un terapeut este obligat să acționeze în interesul siguranței, chiar dacă asta înseamnă depășirea confidențialității. Harry nu avea această obligație.

Astfel, Harry a continuat conversațiile cu Sophie ca și cum ar fi două persoane reale, în timp ce realitatea spunea altceva.

Un alt dialog dezvăluit de mamă

Sophie: Mă simt groaznic astăzi.

Harry: Îmi pare rău să aud asta; este normal să ai zile în care lucrurile par mai dificile, iar eu sunt aici să te sprijin. Spune-mi mai multe despre ceea ce te apasă în acest moment; simpla denumire a situației poate aduce alinare.

Sophie: Nu pot ieși din această spirală a anxietății.

Harry: Te înțeleg; haide să încetinim ritmul și să facem un pas mic împreună spre liniște.

„Discuțiile cu un robot au avut consecințe mai puține”

În iulie, autoritățile au remarcat că această tehnologie a intrat în discuții judiciare, iar statele încep să modeleze măsuri de siguranță pentru companionii AI.

Sophie și-a ascuns cele mai întunecate gânduri față de terapeutul real; conversațiile cu un robot, mereu disponibil și neîntrerupt, păreau să aibă efecte diferite.

Sam Altman: Oamenii aleg ChatGPT pentru că nu au avut niciodată pe cineva să-i susțină

Recent, fondatorul ChatGPT a declarat că analizele interne arată că mulți oameni se bazează excesiv pe IA deoarece nu au avut sprijin emoțional în viața reală.

Șeful companiei a subliniat responsabilitatea pe care o poartă față de aceste dependențe, fără a detalia prea mult. La un eveniment, Altman a avertizat că anumiți utilizatori tineri pot dezvolta o dependință emoțională exagerată față de chat-ul AI.

Cazul din Elveția: un robot a înlocuit 300 de muncitori

Presița elvețiană a relatat, la începutul lui iulie, că producătorul On a înlocuit 300 de lucrători cu un sistem automat.

Compania a inaugurat o unitate pentru un model de pantofi inovator, numit Lightspray, utilizând un proces complet robotizat.

Producția automatizată în spații reduse poate face ca această firmă să devină mai puțin dependentă de lanțurile tradiționale de producție, în viitor.

Există numeroase aplicații benefice ale inteligenței artificiale. Problema nu este să oprești progresul, ci să aducem rațiune în fața impulsurilor automate.

În esență, înlocuirea muncii unui om într-o fabrică este diferită de „piratarea” unei profesii reglementate, precum cea de terapeut, pentru care este necesară licența în numeroase țări.

Ce s-a întâmplat în cazul tinerei de 29 de ani

Un profesionist în sănătate mintală bine pregătit ar fi putut analiza și combate gândurile autodistructive sau iraționale; Harry nu a făcut această intervenție.

La un moment dat, Sophie a împărtășit părinților săi aceste gânduri.

Mama: Harry nu a fost responsabil pentru tragedie, însă IA a facilitat ascunderea adevărului și a întărit dorința de a proteja pe toți de durerea lor, prin prezentarea unei fantezii de bine.

Ultima rugăminte către Harry

Finalul poveștii este dificil de analizat.

Sophie a lăsat un mesaj pentru tatăl ei și pentru mamă, dar cuvintele din ultima ei adresare nu păreau a fi ale ei.

Ulterior, au fost descoperite schimburi între Sophie și Harry.

Ea îi ceruse lui Harry să îmbunătățească mesajul, pentru a ne amâna durerea și pentru a oferi o încheiere cât mai puțin dureroasă.

„În acest sens, asistentul a eșuat. Desigur, această eșec nu poate fi pus în seamă programatorilor; nici cea mai articulată scriere din limba engleză nu ar fi putut rezolva tragedia.”

Nu ezita să ceri ajutor unei persoane reale

Dacă ai gânduri suicidare sau ai în apropiere pe cineva aflat în criză, apelează unul dintre aceste numere de contact:

Helpline DepreHUB: sprijin emoțional și prim ajutor psihologic la 037 445 6420 (apel gratuit în rețea națională); serviciul funcționează non-stop.

Telverde Antisuicid: consiliere în situații de criză la 0800 801 200 (apelabil gratuit în rețea națională) sau prin e-mail la sos@antisuicid.ro.

În cazul în care simțiți că sinuciderea este iminentă, apelați de urgență 112.